🐹倉鼠週報20:當AI成為人類情感的寄託

你有想過與 AI 機器人成為朋友嗎?也許現在我們都很排斥將情感寄託於機器人,但眾多的數據都表明,也許未來 AI 將成為我們關係網中的一員,成為我們都朋友、家人,甚至寵物。

卷首語

最近內容逐漸轉換成觀察與洞察,希望能寫出對讀者有幫助的內容,不然僅僅當個資訊的搬運工,還是很容易被取代的。

未來也將找比較多像 a16z 這類的深度文章來講解。不同的技術進步時很有可能會在同一個生態上爆發,像是 AR/VR + LLM + 元宇宙就可能創造一個新的時代改變。

這個只是我的想像之一,之前的內容也提到過,我對未來的勾勒是建立在『現有的技術基礎 + 可期待的技術進步』上,然後嘗試結合不同的技術做想像。

剛好最近完成一副拼圖,對我來說想像未來的方式就是,抓住未來可能發生的畫面拼圖,然後拼拼湊湊出令人驚豔的場景,不會太過縹緲卻感覺觸手可及。

🛠️ 本週 AI 新聞 & 工具

1. AI 機器人將融入人際關係網,成為我們的家人、朋友

記得在幾個月前,看到 character.ai(各類 AI 機器人)估值十億美元時,我認為它偏向一個玩具,沒有看到它能解決什麼特定需求。

現在看來是我格局小了!

a16z 這篇文章引用了一些相關數據,佐證越來越多人透過 AI 機器人來滿足需要被陪伴及理解的需求:

網紅 Caryn Marjorie 推出的「AI女友」CarynAI(語音聊天機器人)早期社區有超過 20,000 名用戶,用戶與 AI 版本的 Caryn(虛擬女友)聊天需每分鐘支付 1 美元,第一週就收入了 72,000 美元。

Snapchat 的聊天機器人在前兩個月,就有 1.5 億人發送了超過 100 億條信息。

ChatGPT 成為最快達到 1 億用戶的產品。

Replika(AI 女友/男友)應用程式自 2017 年推出以來,部分用戶一直與其 AI 伴侶保持關係。

Character AI 融資好幾億美元,投資人也看中它的潛力。

其實最讓我有即視感的是一款叫『愛說不說』的 app,這是文字類冒險遊戲,但其實它是一款公益遊戲,為了讓人更了解愛滋病病人。

遊戲透過選擇對話的方式來進行互動,但是場景模仿的維妙維肖。彷彿真實的家人、朋友,還有現實動態可以互動。

如果今天是以開放式問答結合 ChatGPT 的方式,可能讓人一不注意就產生情感依賴。

今天就以 a16z 這篇文章當個引子,說說我對 AI 機器人的想法。

▎為什麼未來人們將越來越依賴 AI 機器人?

我們覺得與真實的人互動是無法取代的需求,因為那是真實的溫度。可是上述種種數據表明,也許人們越來越能接受 AI 機器人了。

我們不能接受,也許純粹只是因為『我們上了年紀』。

英國科幻作家 Douglas Noël Adams 提出科技三定律:

任何在我出生時已經有的科技,都是世界本來秩序的一部分

任何在我 15-35 歲之間誕生的科技都是將會改變世界的革命性產物

任何在我 35 歲之後誕生的科技都是違反自然規律要遭天譴的

要知道,現在的小朋友手機幾乎都是形影不離的,他們的社交需求幾乎都是從手機上獲得滿足。

如果真的有 AI 機器人,他們也是最願意嘗試的一批人,只要有個虛擬社區在小朋友之間具備一定的傳播能力,這個社區(或是服務)就可能會快速在抖音等平台傳播開來。

到時候虛擬社區中不只會有真人,也會開始有 AI 機器人。

這個現象就會對應 a16z 在文章中提到:『如今的機器人不僅在一對一對話中有了明顯的改進,而且它們正在進入我們的社交生活。』

Today’s bots aren’t merely a step function improvement on 1:1 conversations—they’re making inroads into our social lives.

AI 機器人將會逐漸融入我們的關係網中,成為我們的朋友、家人甚至寵物。

▎元宇宙中的 AI 機器人

Apple vision 的出現,彷彿讓我們看到《一級玩家》的電影場景出現。

加上 Meta 等公司不斷致力研究著相關技術,戴上頭盔實現擴增實境、虛擬實境的場景,極有可能在未來實現。

上方影片為 meta 的畫面切割模型 Segment Anything Model,快速識別現實物體。

『數位社區』也將是這個場景下發展的一個重點,此時 AI 機器人將會跳離文字,成為一個確確實實存在的『人』(虛擬影像中的人,看起來擁有意識、個性)。

我們可以設定個性化的機器人(LLM)、賦予機器人記憶能力(Vector store)、合成任何我們想要的語言(Speech synthesis for voice)、描繪我們想要的機器人樣貌(Stable Diffusion model for image),最後只要讓這個機器人動起來(Animation for video)。

各項技術都在如火如荼的發展,類 character.ai 的平台發展出各類虛擬人物只是第一步,再來就會在各自的平台上結合上述相關技術,打造出各種版本的機器人。

▎我的想法

我認為最好觀察這項技術的發展應用在於兒童/少年產業及黃色產業。

兒童這塊不贅述剛剛文中提到了,而『黃賭毒』產業一直引領著技術發展,因為利潤高,所以特定技術發展往往會從黃賭毒產業開始,如果連這類產業鏈都發展不起來的技術基本上就沒什麼希望了。

舉例來說,虛擬機器人很有可能優先被做成色情機器人,不管是文字、語音或是虛擬版本的,一旦快速火熱起來,那這個技術就很很高的機率未來會實現。

對於我們來說,也許科技的改變是違反天理的、可怕的。但技術往往就像是一個生命體,一旦開始生長了就很難限制且成長。

Tegmark 在他的書《生命 3.0》中說過,隨著技術越來越強大,試錯的成本也將越來越高,甚至不允許犯錯,我們該如何與技術『共存』是最重要的議題(也是 OpenAI 在積極解決的問題)。

另一方面,AI 又像一面『道德的鏡子』,隨著我們思考 AI 的道德觀該如何設定時,同時也是在思考什麼是人類的道德觀/價值觀。

我們正在進入一個全新的世界,這個世界將會比我們能夠想像的更加奇怪、狂野和美妙。技術的發展是無法避免的事,我們唯一能做的就是參與其中,並推動 AI 往好的方向發展。

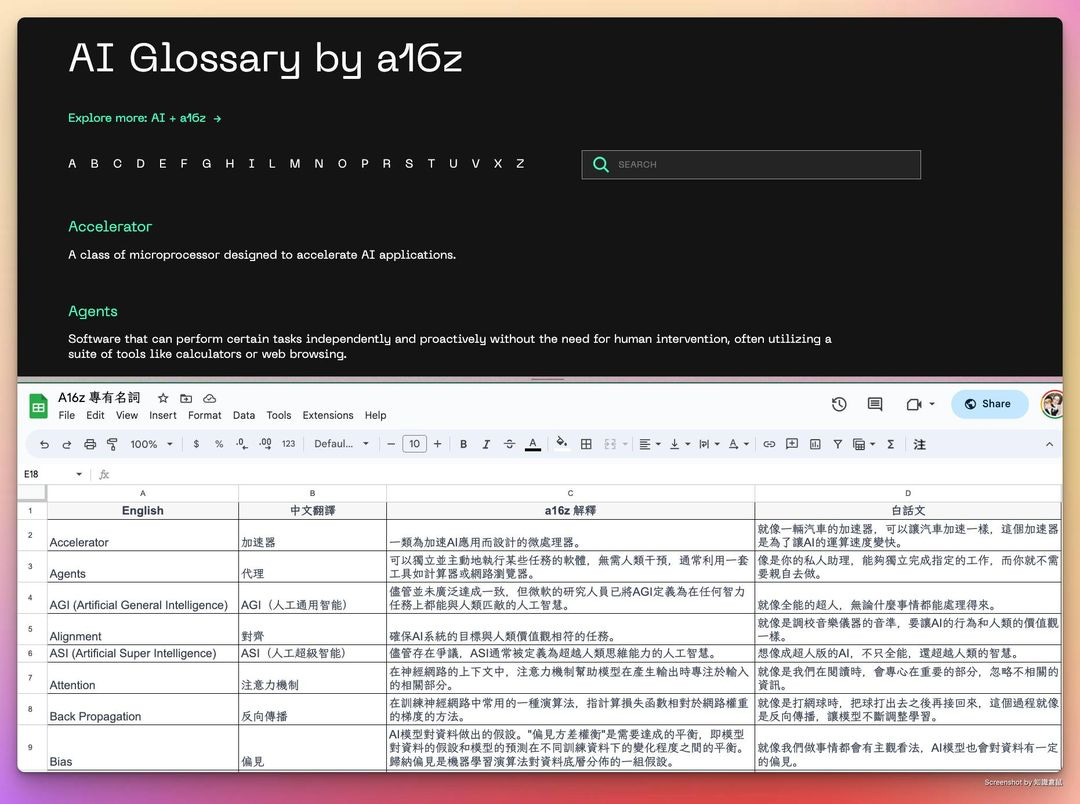

2. a16z 的 AI 專有名詞

a16z 是美國的一家著名風險投資公司,上面的部落格內容也有很多極具洞察力的文章。

近期 a16z 也整理了一份 AI 專有名詞庫,我把它翻譯成中文,並用 ChatGPT 加入了一個『白話文』欄位。

用的是『請用中學生也能聽懂的比喻說明該名詞』,更方便大家理解不同名詞。

不過那只是比喻解釋,有些不能完全當作是正確的解釋,請留意。

表格解釋:https://docs.google.com/spreadsheets/d/16Pnmr0jleDoCnTmPAVerryW2I08O_VLBtN6yw28XMEo/edit#gid=0

a16z 文章原文:https://a16z.com/ai-glossary/

3. 機器人透過看影片來學習新技能

該技術的目標是讓機器人透過觀察人類的行為來學習與環境互動。

本篇模型與方法:

視覺可供性模型 (Visual Affordances Model)

視覺-機器人橋接方法 (Vision-Robotics Bridge)

透過 VRB 技術,只需要參考影片,不需要人類互動或模擬環境,就能在 25 分鐘內教會機器人新任務。

這種技術的重要性在於,它可以讓機器人更好地理解並適應不同的環境和任務。

▎4 種機器人學習模式

研究人員將這種模型與 4 種機器人學習模式無縫地整合在一起。

他們想證明透過這種方法 (模型),機器人在 4 種真實環境、超過 10 種不同的任務和 2 種野外操作的有效性。

以下是 4 種學習模式:

1. 離線模仿學習(Offline Imitation Learning)

這種學習方式就像是我們看著老師解題,然後模仿解題步驟一樣。

這種模式下,機器人會觀察並學習人類的行為,然後嘗試模仿這些行為以完成特定的任務。

2. 探索(Exploration)

這就像是我們在新的城市裡四處走動,嘗試找出最好的路線或是最好吃的餐廳。

這種模式下,機器人會在環境中自由地移動並嘗試不同的行為,以了解哪些行為可以達成目標。

3. 目標條件學習(Goal-Conditioned Learning)

這就像是我們設定了一個目標(比如要考取某證照),然後根據目標來規劃學習路徑。

在這種模式下,機器人會根據特定的目標來學習和選擇行為。

4. 行動參數化的強化學習(Action Parameterization for Reinforcement Learning)

這就像是我們在玩一個遊戲,不斷嘗試不同的策略,看哪一種策略可以得到最高的分數。

在這種模式下,機器人會透過試錯的方式,不斷調整行為參數,以找出最能達到目標的行為。

研究來源:https://robo-affordances.github.io/

4. 叫 ChatGPT 當 OO 專家真的有效!

上方影片是 Andrej Karpathy 在 State of GPT 的演講片段。

這段特別解釋在所有 LLM 上寫 prompt 時,請它假設自己是 OO 專家真的有助於提升回覆品質。

關鍵點在於『LLM 並不追求成功,而是追求模仿』。

LLM 在訓練時的資料一定會有高品質跟低品質的資料,而 LLM 本身又是一個『文字接龍大師』。

所以它的目標是模仿並創造出一段合適的文字,而不是最佳的文字。

但當我們今天將 prompt 定位在『你是某某專家時』,回覆的答案就會有更高機率是高品質的答案,因為它必須模仿出專家的答案。

從另一個角度來看,定義 ChatGPT 是某某專家,就是在透過定義角色來把問題的範圍給限縮,然後用精準定位問題的方式來解答。

現在知道了,原來原理是透過 prompt 把答案用機率分佈的方式來限縮解答範圍。

===========================================

以下是影片字幕內容:

下面我要講的這點對LLM的理解非常有趣,我覺得這算是LLM的一種心理特性:

『LLM 並不追求成功,而是追求模仿。你希望它成功,那就需要向它明確要求。』

這裡的意思是,在訓練 Transformer 的過程中,它們有各種訓練集,而這些訓練資料中可能涵蓋了各種不同品質的表現。

比如,可能有一個關於物理問題的提示,然後可能有學生的解答完全錯誤,但也可能有專家的答案完全正確。

儘管 Transformer 可以識別出低品質的解決方案和高品質的解決方案,但默認情況下,它們只會模仿所有的資料,因為它們僅僅是基於語言模型進行訓練的。

在實際測試中,你其實需要明確要求它表現得好。在這篇論文的實驗中,他們嘗試了各種提示。

例如,“讓我們逐步思考”這種提示就很有效,因為它把推理過程分散到了許多記號上。

但效果更好的是這樣的提示:“讓我們以一步一步的方式解決問題,以確保我們得到正確的答案。”

這就好像是在引導 Transformer 去得出正確的答案,這會使 Transformer 的表現更好,因為此時 Transformer 不再需要把它的機率品質分散到低品質的解決方案上,儘管這聽起來很荒謬。

基本上,你可以自由地要求一個高品質的解決方案。比如,你可以告訴它,“你是這個話題的領先專家。假裝你的智商是120。”

但不要嘗試要求太高的智商,因為如果你要求智商400,可能就超出了資料分佈的範圍。

更糟糕的是,你可能落入了類似科幻內容的資料分佈,它可能會開始展現一些科幻的,或者說角色扮演類的東西。

所以,你需要找到適合的智商要求。我想這可能是一個U型曲線的關係。

5. 生成式 AI 的應用路線圖

分享一個看到關於 AIGC 的應用路線圖,很完整清晰值得參考。

- [a16z, It’s Not a Computer, It’s a Companion!](https://a16z.com/2023/06/22/its-not-a-computer-its-a-companion/)

- [Li Jin, Building Psychological Attachment — Not Just Ownership — Into Web3](https://hbr.org/2023/04/building-psychological-attachment-not-just-ownership-into-web3?ab=hero-main-text)